Digitale video

1 bit (Digitale video)

1PM: Basisbegrippen Video / 2015_2016 / Laatste aanpassing op 2016-06-19.

Klopt het als ik zeg dat een bit de kleinste eenheid aan info is, De bit is de kleinste eenheid aan info als we over digitale informatie babbelen.

maar dat niet elk signaal gelijk staat een 1 bit, maar 2 signalen door 1 bit kunnen worden doorgegeven en 9 signalen bijvoorbeeld door 4 bits? Ik snap niet wat je hiermee bedoelt.

Wat als gevolg heeft dat niet elk pixel (opgebouwd uit een signaal voor synchronisatie, kleur en helderheid) door even veel bits wordt doorgestuurd, maar pixel x bijvoorbeeld uit 2 bits bestaat en pixel y uit 5 bits?

Voor een videobeeld wordt gecompresseerd, heeft ieder pixel steeds evenveel bits nodig om de helderheid en kleur aan te geven.

Berekenen aantal samples (Digitale video)

1BGM: Videotechnieken / 2006_2007 / Laatste aanpassing op 2007-09-01.

bij digitale video:

in component signaal hebben ze voor het gemak een gemeenschappelijke samplingsfrequentie voor genomen 13.5 Mhz dit is voor pal 864 x de lijnfrequentie maw in 1 lijn wordt er 864 keer een monster genomen

nu in het samplingsmodel 4:2:2 vraagt men eigelijk achter 720 helderheids sampels en 2x360 kleurverschilsamples wat neerkomt op 1440 samples voor het actieve beeld voor helderheid en kleur samen.

maar 864 samples van 8 bit komt neer op 864 byte ( 8 bit is 1 byte)

hebben eigelijk 1440 samples nodig van 8 bit dus .....

Deze 864 zijn het aantal keren dat er een sample wordt genomen van het videosignaal per volledige lijn. Dat levert dus 864 helderheidssamples, en 864 kleurensamples.

De 1440 zijn het aantal datawaarden die worden gemaakt in het actieve gedeelte van een lijn: 720 voor de helderheid, 360 voor het rode kleurverschilsignaal, en 360 voor het blauwe kleurverschilsignaal.

ja ik weet niet het is mij weeral niet echt duidelijk u redenering op LB V2.6 over een digitale lijn.

die 1440 samples voor het actieve beeld dat u nodig heeft hoe komt het dat er bij een samplingsfrequentie van 13.5 Mhz waarbij er maar 864 samples beschikbaar zijn u nog plaats over heeft identificatie, timing , embedded audio ? waar haalt u dat vandaan???

864 voor de volledige lijn, min de 720 voor het actieve gedeelte van de lijn, geeft een overschot van 144 samples.

of moeten we die 864 zien als periodes in de lijn en vermits we 2 sampels per periode nemen

hebben we eigenlijk 1728 samples beschikbaar en zo dus

1728-1440=288 288 sampels van 8 bit over en dus ook 288 byte?

Neen, als je het hebt over 720 of 864 samples, dan gaat het over het aantal keren dat het videosignaal geapled wordt.

Als je het hebt over 1440 of 1728 samples, dan gaat het over het helderheids- en kleurensignaal samen.

maar dan snap ik niet een sample frequentie van 13.5Mhz dat betekent 13500000 keer per seconde een sample neemt en er zijn 15625 lijnen per seconde dan komt ik toch uit op 864 samples maar per lijn en dat is nog eens een lijn van 64µs niet eens van 52µs.

Bitrate (Digitale video)

2BGM: TVstudiotechnieken / / Laatste aanpassing op 2006-06-25.

Bij 4:2:2 staat in de

cursus: "Per lijn worden er dus 720 (Y) en 2*360 (R-Y; B-Y), of 1440 samples

doorgestuurd. Bij een 8-bits sampling levert dit 216 Mb/s, bij 10 bits wordt dit

270 Mb/s. Indien enkel het actieve beeld wordt verwerkt, wordt dit

respectievelijk 166 Mb/s en 207 Mb/s."

Kloppen deze

berekeningen?

Het

aangegeven aantal samples staat voor het aantal aktieve samples. Deze worden

bekomen bij een sampling van Y aan 13,5 MHz, en R-Y en B-Y aan 6,75 MHz. In

totaal dus 13,5 + 6,75*2 = 27 Msamples/sec. Als we dit nemen aan 8 bit komen we

op 27*8=216Mbit/sec, of 27*10=270Mbit/sec.

Bitrates (Digitale video)

1BGM: Videotechnieken / 2006_2007 / Laatste aanpassing op 2007-09-01.

bij de bitrate van 4.2.2 snap ik iets niet goed

per lijn 1440 actieve samples

er zijn 625 lijnen per beeld

en er zijn 25 beelden per seconde

bij een 10 bits sampling krijg je toch 225Mb /s ( in de curses staat 270Mb/ s)

10* 1440 * 625 *25=225 000 000 bits per seconde

bij 270Mb/s krijgen we dan

270 000 000 /(1440*25*8)= 937.5 lijnen?????

want zoals in de cursus wordt vermeld " als we enkel het actieve beeld ( moet dat trouwens niet 575 ip 576 zijn ( men neemt 2X 25 lijnen weg van de rasteronderdrukking)) sampelen kom ik ok aan een waarde van 207 Mb/s

10*1440*575*25=207 000 000 Mb/s

Bij SDI worden niet enkel de actieve samples doorgestuurd, maar alle 864 samples van een videolijn.

Dan kom je wel op 270Mb/sec.

Bij digital video wordt de halve lijn aan het eind van raster 1, en bij het begin van raster 2 doorgetrokken over de volledige lijn. Daardoor komt er een volledige lijn aan actieve video bij, en komen we op 576 actieve lijnen in een beeld

Bitrates berekenen (Digitale video)

1BGM: Videotechnieken / 2006_2007 / Laatste aanpassing op 2014-05-18.

> 4. (LB V2.6) p 228: Digitale video: Component: sampling: 4:2:2

> "Per lijn worden er dus 720 (Y) en 2*360 (R-Y;B-Y), of 1440 actieve

> samples doorgestuurd. Bij 8-Bits sampling levert dit 216 Mb/s, bij 10 bits

> wordt dit 270 Mb/s. Indien enkel het actieve beeld (576 lijnen) wordt

> verwerkt, wordt dit respectievelijk 166 Mb/s en 207 Mb/s."

>

> Hoewel het hier waarschijnlijk een eenvoudig rekensommetje betreft, ik heb

> geen idee hoe u aan 216Mb/s, 270Mb/s, 166Mb/s en 207Mb/s komt.

Sampling aan 13,5 MHz

10 of 8 bits per sample

Steeds 1 Y-sample en 1 Chroma sample (Pr of Pb)

Dus:

13,5 Msample/sec * 10 bits/sample * 2= 270Mbit/sec

13,5 Msample/sec * 8 bits/sample * 2= 216Mbit/sec

Als we enkel het actieve beeld nemen:

1440 samples / lijn

576 lijnen / beeld

25 beelden/sec

10 of 8 bits per sample

Dus:

1440 samples/lijn * 576 lijnen/beeld * 25 beelden/sec * 10 bits/sample = 207.360.000 Bit/sec

1440 samples/lijn * 576 lijnen/beeld * 25 beelden/sec * 8 bits/sample = 165.888.000 Bit/sec

Color sampling (Digitale video)

1ASS: Basisbegrippen Video / 2015_2016 / Laatste aanpassing op 2016-04-19.

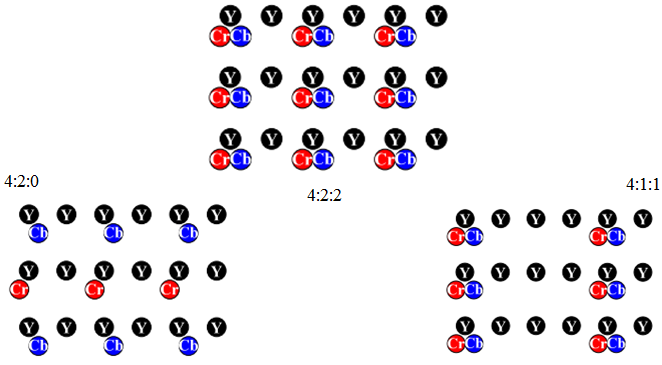

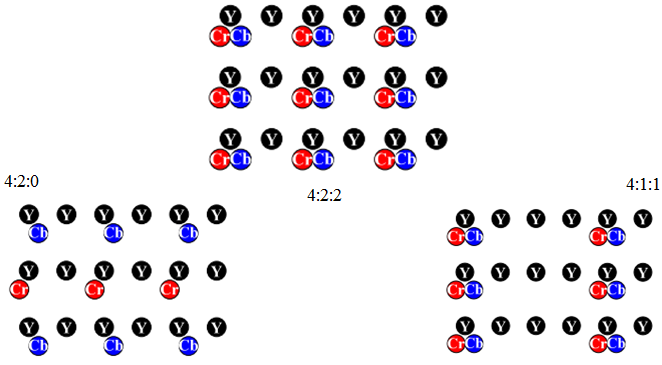

Ik zit al een tijdje te staren en na te denken over de slide op bladzijde 40 over het samplen van de kleuren (voor duidelijkheid: zie foto). Ik begrijp waarvoor de 4:2:2 verhouding staat maar ik zie het veband niet met de bolletjes die erbij staan als illustratie. Bij 4:1:1 en 4:2:0 zien de bolletjes er anders uit en staan ze ook anders maar ik weet niet hoe dat komt. Zou U mij dit aub in het kort willen uitleggen als dit mogelijk is?

Alvast bedankt!

Ik heb de figuur hier in kleur bijgevoegd.

Beschouw 4:2:2, 4:2:0 en 4:1:1 gewoon als een benaming. Als je het detail hiervan wil weten, kan je kijken op https://en.wikipedia.org/wiki/Chroma_subsampling

Bij het digitaliseren van videobeelden, worden heel veel gegevens aangemaakt. Het is van belang een manier te vinden om deze hoeveelheid aan gegevens te beperken.

In ons oog wordt het beeld als helderheid en kleur behandeld. Voor het oog is de helderheid belangrijker dan de kleur.

Dat wil dus zeggen dat we van de helderheid meer pixels moeten digitaliseren dan voor de kleur.

De zwarte bolletjes stellen de beeldpunten voor waarvan de helderheid wordt gedigitaliseerd.

De rode bolletjes stellen de beeldpunten voor waarvan het rode kleurverschilsignaal wordt gedigitaliseerd.

De blauwe bolletjes stellen de beeldpunten voor waarvan het blauwe kleurverschilsignaal wordt gedigitaliseerd.

4:4:4 (hier niet getoond) neemt van iedere pixel de helderheid en de kleur.

4:2:2 geeft de beste beeldkwaliteit van deze 3 voorbeelden. Het is de kwaliteit die wordt gebruikt voor postproductie.

4:2:0 en 4:1:1 hebben nog steeds evenveel helderheidspunten als 4:4:4 en 4:2:2, maar ze hebben minder kleurenpunten. Het totaal van de gegevens (de helderheids en kleurenpunten samen) is lager, en neemt dus minder ruimte in op de harde schijven. De kwaliteit is dus ook lager. Deze kwaliteit wordt gebruikt voor consumer toepassingen en voor uitzendingen.

Colorimetrie HD (Digitale video)

1BGM: Videotechnieken / 2006_2007 / Laatste aanpassing op 2007-05-26.

> - In de minimumlijst spreekt u over het verschil in colorimetrie van SD

en

> HD; maar ik blijk deze informatie in dit hoofdstuk nergens terug te vinden?

Dit staat bij Colorimetrie

Componenten (Digitale video)

1BGM: Basisbegrippen Video / 2014_2015 / Laatste aanpassing op 2015-01-02.

Dag meneer, bij het stuk over PAL / Digitale video kwam ik iets tegen dat me in de war bracht, en ik het anders het verstaan uit de vorige slides / opzoeking.

U zegt op pagina 37 van de slides, de laatste regel: "Y, U en V (of Y, B-Y en R-Y ) zijn de benamingen voor de analoge kleurverschilsignalen, Y, Cr & Cb (of Y, Pr & Pb) zijn de benamingen voor de digitale componenten."

Waar ik verward ben is bij: "Y U & V (of Y, B-Y en R-Y) zijn de benamingen voor analoge kleurverschilsignalen". de Y in deze is toch geen kleurverschilsignaal maar een Luminantie signaal / component? Ook begreep ik niet goed wat deze specifiek met analoog te maken hebben?

Daarnaast dacht ik ook dat Y Pr & Pb specifiek bij analoge toestellen werd gebruikt en dat Y, Cr & Cb pas ontstaan is met de opkomst van digitale video om een systeem te hebben dat zowel digitaal als analoog kan 'lezen' (om het simpel te stellen)?

Ik dacht dat elk van deze 4 een andere soort van encoding waren, die wel allemaal gebaseerd zijn op de luma-chroma theorie.

Er staat inderdaad een fout in de slides.

R, G, B, H, V: Analoge componenten plus de horizontale en verticale syncpulsen

R, G, B, S: Analoge componenten plus de samengestelde synchronisatie

R, G, B: Analoge componenten met de samengestelde synchronisatie op groen

Y: benaming van het luminantiesignaal. De berekening ervan verschilt volgens de gebruikte norm

Y, R-Y, B-Y: analoge componentsignaal, waarbij R-Y en B-Y de kleurverschilsignalen zijn

Y, U, V: analoge componentsignaal, waarbij U en V de gereduceerde kleurverschilsignalen zijn, V=0,8777 (R-Y), U=0,493 (B-Y)

Y, Pr, Pb: analoge componentsignaal, waarbij Pr en Pb de kleurverschilsignalen zijn, Pb= 0,564 (B -Y), Pr = 0,713 (R-Y)

Y, Cr, Cb: digitale componentsignaal, waarbij Cr en Cb de gesampelde kleurverschilsignalen zijn van Pr en Pb

Voor de eenvoud heb ik in dit overzicht geen rekening gehouden met gammagecorrigeerde signalen.

Ook nog, Y,Pr,Pb is pas populair geworden bij de introductie van digitale toestellen in de consumermarkt. In de professionele markt gebruikte men Y,R-Y,B-Y volgens de SMPTE,EBU of Betacam standaard.

Digital cinema (Digitale video)

2BGM: TVstudiotechnieken / 2004_2005 / Laatste aanpassing op 2006-06-25.

Er staat in de tekst dat voor dig. cinéma

men gebruik maakt van 1080i (pg1) terwijl er verder in de cursus (pg3) bij de

normen 1920 * 1080 * 30/24/25p. 24,25,30 slaat op cinéma, dit zijn toch het

aantal bps in de cinéma, maar nu spreekt men van p voor progressieve structuur

en niet meer van i van interlaced. Of moeten hier de progressieve beelden nog

omgezet worden?

Het probleem wat je aanhaalt

voor HD is zowat kenmerkend voor wat er aan het gebeuren is. Omdat HD nog

relatief jong is, zijn de normen zich nog aan het zetten.

Voor digitale cinema is het

probleem van bandbreedte minder belangrijk dan dat van kwaliteit. Het gaat hier

immers over projectie in zalen, en niet over het uitzenden van programma's.

1080P heeft een bitrate van ongeveer 3Gb/sec, 1080I zit op ongeveer 1,5Gb/sec.

De beeldkwaliteit van 1080P is natuurlijk beter dan die van 1080I.

1080P is wat men (nu) wil

kiezen voor 'digital cinema'. Afgeleid daarvan wil men 1080P voorstellen voor

TV kanalen die zich vooral op films willen richten.

Omdat het eenvoudiger is om

van 1080P naar 1080I te gaan, zal men voor 'digital cinema' opnemen op 1080P, en

nadien voor uitzending op TV omzetten naar 1080I.

Een omzetting van I naar P

gaat rasterfouten geven. (Zie maar naar het freezen van een PAL beeld in een

montage programma).

Dan zeg je ook nog

"24,25,30 slaat op cinéma", dat klopt niet. Het geeft het aantal

beelden weer. 25 is bv dePAL, en 30 (29,97) de NTSC beeldfrequentie.

Maar: Digitaal werken met film

( de eigelijke DIGITAL CINEMA) bestaat al langer. Het gaat hier over het

afzonderlijk inscannen van ieder beeldje appart. Er wordt dan ook niet gewerkt

met YUV, maar met RGB beelden, waarbij iedere kleur aan de volledige resolutie

wordt opgeslagen op harde schijven. Hier spreekt men van 2K en 4K beelden: een

resolutie van 2000 of 4000 punten.

Digitalisatie (Digitale video)

2BGM: TVstudiotechnieken / 2005_2006 / Laatste aanpassing op 2006-06-25.

> blz. 65 onderaan: E'r-E'y zal als uiterste waarden +0,701V en -0,701V en

> E'b-E'y +0,886V en -0,886V hebben; komen die waarden van ergens of moeten we

> ze gewoon aannemen?

Als je voor alle mogelijke kleuren de waardes berekent, dan zal je zien dat dit de uiterste waarden zijn. Ik moet toegeven dat ik dit zelf ook niet heb berekend, maar het zijn waarden die in verschillende texten terugkomen.

> blz. 67: hoe zit dat met die "XY" en tijdreferentiegegevens, kan ik even

> niet volgen...

Met "XY" worden 2 Nibbles aangegeven, dus in totaal 8 bits. De tabel daaronder geeft aan wat er in die 8 bits zit, bv een bit om aan te geven of het een lijn nuit het eerste of het tweede raster is (F), een bit om aan te geven of het een videolijn uit de rasteronderdrukking is of niet (V), ..., en nog wat bits om aan foutcorrectie te doen (P0-P3)

Digitaliseren (Digitale video)

2BGM: TVstudiotechnieken / 2004_2005 / Laatste aanpassing op 2006-06-25.

klopt dit volgend tekstje? dan snap ik het begin al van dig video, gewoon even ter

controle.

> "Component video

bevat de drie gescheiden signalen Y, Pb en Pr (ook wel Y, Cb en Cr genoemd).

Waarbij Y het helderheidsignaal is, Pb (of Cb) het blauw signaal minus de

helderheid (Y) en Pr het rood signaal minus de helderheid. dus kortmweg:

component bestaat uit: Y, (R-Y) en (B-Y). Dit is bedacht omdat dit signaal bij

hogere resolutie een betere beeldkwaliteit oplevert

Neen. Het omzetten van RGB naar YUV is gedaan om een andere

reden.

-> Eerst is er de compatibiliteitsvoorwaarde: Men moet er voor

zorgen dat een kleurensignaal ook op een zwart-wit toestel te zien is. In de

kleurensignaal moet dus ook de helderheid zitten. Daarom zit er dus 'Y' in det

gebruikte componentsignaal.

-> Dan zijn ze ook R-Y en B-Y gaan gebruiken,

omdat voor kleurloze (zwart-wit) beelden R-Y en B-Y nul is. R-Y en B-Y kunnen

we dus echt wel zien als 'kleurtoevoeging'.

> dan RGB (= composiet)

RGB = COMPONENT!!!, De 3 kleuren zitten op 3 verschillende kabels,

de sync zit meestal op een 4 kabel. Men spreekt van composiet als de helderheid

en de kleur samen zitten op 1 draad. De helderheid zit er van 0->5 MHz,

ongemoduleerd, de kleur zit er doorheen, gemoduleerd rond 4,43 MHz.

(welke naast rood, groen en blauw ook

een los synchronisatie signaal nodig heeft). bij composiet haalt men de

helderheid uit het groene composietsignaal.

Om uit

composiet groen te halen, moet het composiete signaal eerst de decodeerd

worden. We hebben dan Y, U en V

Uit Y, U en V worden eerst R en B gehaald.

Daarna kan met R, B en Y samen G bepaald worden. In de praktijk gebeurt dit

(YUV -> RGB) wel allemaal in 1 stap.

>daarnaast werken tv's intern ook

met YUV waardoor er niet nog een RGB -> YUV conversie plaats hoeft te

vinden

Klopt.

> wat invloed op de kwaliteit zou

hebben."

Het zou de TV ook duurder maken

Digitaliseren (Digitale video)

2BGM: TVstudiotechnieken / 2004_2005 / Laatste aanpassing op 2006-06-25.

> de bitrate is gelijk aan de fs

van de 3 kleurcomponenten x het aantal bits

> voor 422 dus 27x8=216 mb/s

voor 8bit want 13.5+6.75+6.75=27

> voor 420 kom ik aan 20.25x8=162mb/s

want 13.5+6.75=20.25

> in de cursus staat echter 124bit voor 420

Je hebt een belangrijk gedeelte van de zin vergeten te lezen:

"voor het actieve beeld"

Het gaat hier dus over

576 lijnen van de 625, en 53,333µs van de 64µs voor de lijntijd.

Er wordt enkel met het

actieve gedeelte geteld in dit geval, omdat als we het hebben over 4:2:0 en

4:1:1, we het hebben over het verwerken van beelden in computers, MPEG coders,

... Op dat moment wordt het gedeelte van het beeld in de onderdrukking immers

niet verwerkt.

> de header bij sdti is dit de

ruimte tussen eav en sav of is dit de ruimte

> boven de 100 ire of zijn

dit gewoon extra bits opgenomen enkel voor

> transmissie of nog iets

helemaal anders?

Op een SDTI verbinding

wordt de (gecompreseerde) video in pakketjes verstuurd. Een header is een

beetje informatie dat vlak voor zo'n pakketje wordt gestoken.

> is er bij dct eigenlijk een

dubbele weging? één vastematrix)( en één in te stellen door de gebruiker

(schaal)?

Inderdaad, er is

een vaste matrix, die eigenlijk het belang van de verschillende coëfficienten

aangeeft, en een tweede die door de MPEG coder wordt gekozen in functie van de

gevraagde compressierate, en de 'ingewikkeldheid' van het

videobeeld.

> waarom heb je de 3e harmonische van een digitaal

signaal nodig om voldoende stijle flanken te bekomen bij transmissie?

Als je het SDI-signaal

opdeelt in de fourriercomponenten, dan bekom je een heel groot aantal

harmonischen.

Als we het SDI signaal

terug willen samenstellen uit deze componenten, dan blijkt dat we er minstens

een 3-tal van nodig hebben om dit signaal terug te bekomen in een voldoende

kwaliteit.

> vanwaar komen de waarden

0,701 voor Cr en 0,886 voor Cb, moeten we deze

waarden en hun herkomst uberhaupt kennen? :-)

De waarde

moet je niet van buiten kennen. De grootteorde wel.

Ze zijn empirisch

vastgesteld. Ze zijn op een gelijkaardige manier bekomen als de waarden in de

volgende formules bij NTSC:

V = 0,8777 (R-Y)

U = 0,493 (B-Y)

> p105 moet dit niet interframe

zijn ipv intraframe (immers tijdredundantie)

Ik heb hier

geen cursus met de paginanummers, dus ik weet niet waar het hier juist over

gaat.

Een intrabeeld is een

I-beeld: het is en beeld dat alle gegevens in zich heeft om gedecodeerd te

worden. Het maakt geen gebruik van tijdsredundantie.

Intrabeelden worden ook

gebruikt in MPEG compressie. Het zijn de I-beelden die de GOPS van elkaar

scheiden.

> macroblocks

> 'de

grote vd macroblocks is ahfhankelijk van de gekozen sampligstructuur' slaat dit

op de fysieke grote (aantal pixels) of de grote van de informatie (aantal

bits)

> maw pakt men steeds de opp van 4 lumabloks met dus minder data

voor 420 codering of pakt men steeds 4 sampleblocks waarbij de opp van een

makroblok voor kleurinfo dus 4x zo groot is als die van een makroblok voor luma

maw gebeurt deze codering afzoderlijk voor y cr cb of gebeurt deze samen?

Een macroblock heeft

steeds 4 DCT blocks, maw 16*16 luma samples.

Het aantal

chromasamples dat er bij komt hangt af van de gekozen sampling: 4:2:2 - 4:2:0 -

4:1:1

De 'fysieke grootte' is

dus steeds dezelfde, maar de hoeveelheid informatie kan dus verschillen.

Digitaliseren (Digitale video)

1BGM: Videotechnieken / 2005_2006 / Laatste aanpassing op 2006-09-23.

3. Bij een digitaal component signaal stuurt men Y, k1(R-y) en k2(B-y) door.

Voor wat staan de 2 factoren k1 en k2? Voor het digitaal uitvoeren van de

gammacorrectie?

Heeft niets te maken met de gamma:

Als de waarden van de primaire signalen op 1 V worden genomen, zal het E'Y-signaal

variëren tussen 0 en 1 V. E'R-E'Y zal als uiterste

waarden +0,701 V en -0,701 V hebben voor verzadigd rood en cyaan. E'B-E'Y

zal als uiterste waarden +0,886 V en -0,886 V hebben voor verzadigd

blauw en geel. Om de top-top-waarden tot 1 V te beperken (-0,5 V tot

0,5 V) worden twee coëfficiënten bepaald:

zodat we krijgen:

CR = k1 (R'-Y')

CB = k2 (B'-Y')

Digitaliseren: Ey Eb Er (Digitale video)

2BGM: TVstudiotechnieken / 2004_2005 / Laatste aanpassing op 2006-06-25.

op pag 78 in de cursus

bij onderdeel digitaliseren staat er:

als de waarden van de primaire signalen

op 1V worden genomen, zal het

E'y-signaal variëren tussen 0 en 1

V.

wat bedoel je met primaire signalen? en wat met E'y?

Met de

primaire signalen bedoel ik R, G en B.

E'y, E'b en E'r zijn signalen die

R, G en B voorstellen met een amplitude

van 1V. Voor R, G en B is dat

slechts 0,7V.

Notatie (Digitale video)

1BGM: Videotechnieken / 2016_2017 / Laatste aanpassing op 2017-04-26.

er zijn een paar notities die ik niet begrijp bijvoorbeeld “OOH” en “FFH”

De index ´H´ wil zeggen dat het getal ´00´ hexadecimaal moet worden gelezen.

00H is 0 decimaal

FFH is 255 decimaal.

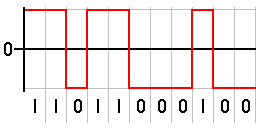

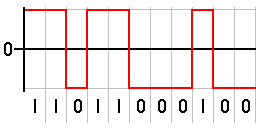

NRZ / NRZI (Digitale video)

1BGM: Videotechnieken / 2006_2007 / Laatste aanpassing op 2007-05-26.

> - p. 242: Parallel transport: Wat bedoelt u precies met het NRZ signaal

> waar geen codering/scrambling (wat is trouwens scrambling?) is voorzien?

> En wat is dan het wezenlijke verschil met een seriële interface?

NRZ: Non return to zero: de bitjes worden doorgestuurd als een spanning

vb: "0"= 0V, "1"=5V

NRZI: Non return to zero, inverted: de bitjes worden doorgestuurd als een

verandering:

"0"= op 0 of 5 volt blijven

"1"= van 0 naar 5V gaan of omgekeerd

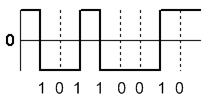

NRZI (Digitale video)

2BGM: TVstudiotechnieken / 2005_2006 / Laatste aanpassing op 2006-06-25.

Bij het leren van de cursus Studiotechnieken 2BGM (versie 4.0) heb ik een kleine bedenking gemaakt bij een tekening. Het betreft op pagina 74

onderaan de tekening ivm de Non Return To Zero Inverted Code. Ik moet deze code ook kennen voor de cursus Analoge en Digitale Technieken van uw

collega Dhr Sleeckx. Omdat ik zeker wou zijn heb ik even op internet gezocht (hoewel de informatie op internet ook fout kan zijn). Ik vond

onderstaande link op Wikipedia.org. http://en.wikipedia.org/wiki/Non-return-to-zero,_inverted

Daar staat een schematische voorstelling van de NRZI-code, en men heeft daar enkel een overgang (transition) bij een logische nul. In uw cursus

echter, op pag 74, staat net het omgekeerde, dat er namelijk een overgang is bij een logische "één".

Na opzoeking in de nota's van A&DT staat dat er ook een overgang is voor een logische "één" en geen voor een logische "nul".

Nu vraag ik me af of de fout niet op de bewuste link van wikipedia staat, of dat er nog niet geïn-verteerd is. Zo zie je maar dat zelfs een

encyclopedie van Wikipedia niet steeds 100% te vertrouwen is.

Ik ga ervan uit dat uw cursus juist is, en die van Dhr Sleeckx ook, en de pagina van Wikipedia fout. Klopt dat?

Er bestaat ook een NRZI systeem dat inverteert op een

'0'.

Deze heet: Non Return to Zero Inverted on Space

Reclocking (Digitale video)

1BGM: Videotechnieken / 2005_2006 / Laatste aanpassing op 2006-09-23.

-) Ik vroeg me af of

reclocking gelijk is aan EQ en triggering+ het juist zetten in tijd. Of is

reclocking alleen het juist zetten in tijd?

De

naam doet alleen blijken aan het juist zetten in tijd maar in de uitleg staat

bij recloking dat dit signaal OOK qua timing gecorigeerd word.

Reclocking

op zich is het juist zetten in tijd van de flanken van het digitale

videosignaal. Het woordje 'ook' is inderdaad misleidend. In de text

voor volgend jaar heb ik het er al uit gehaald.

Sampling (Digitale video)

2BGM: TVstudiotechnieken / 2001_2002 / Laatste aanpassing op 2006-06-25.

Hier begin ik alles wat door elkaar te slaan vrees ik: bij

composietvideo is de samplingfrequentie 4x de kleurendraaggolffrequentie, en dus

verschillend per norm, bij componentvideo is de frequentie voor alle normen 13,5

MHz, maar waarop slaat dan de benaming 4:2:2 ? 4 staat voor Y, 2 voor U en de

andere 2 voor V, dat is dus component, en de samplingfrequentie van component

ligt toch vast? 13,5 MHz is toch niet 4x de kleurendraaggolf van PAL (4,43

MHz)of van NTSC(3,58 MHz)? Wat is dan het verband tussen de 4 uit 4:2:2 en 13,5

MHz?

De cursus (p97 in V3.0) is hierover niet echt duidelijk, want daar staat

dat de referentie voor de 4 de kleurendraaggolf van NTSC is, maar 4 x 3,58 is

toch niet gelijk aan 13,5?

Omwille van

de eenvoud van ontwerp, en om het mogelijk te maken toestellen te gebuiken in

zowel PAL als NTSC-omgevingen, is gekozen voor een gelijkaardige sampling in de

twee normen.

De benaming van de samplingstructuren komt van het feit dat de

samplingfrequentie voor de digitale signalen ONGEVEER 4 maal de

kleurendraaggolf is. Het is enkel een benaming, geen absoluut gegeven.

Sampling (Digitale video)

1BGM: Videotechnieken / 2013_2014 / Laatste aanpassing op 2014-05-29.

Bij digitale video, pagina 236 versie LB V4.0, staat er bij de figuur onderaan: 6.25 MHz bij de switch. Moet dit niet 6.75 MHz zijn? De helft van 13.5 MHz.

Klopt, dit staat verkeerd in de cursus.

Sampling (Digitale video)

2BGM: Videotechnieken / 2013_2014 / Laatste aanpassing op 2014-05-29.

Bij digitale video, pagina 236 versie LB V4.0, staat er bij de figuur onderaan: 6.25 MHz bij de switch. Moet dit niet 6.75 MHz zijn? De helft van 13.5 MHz.

Klopt, dit staat verkeerd in de cursus.

SDI (Digitale video)

1PBAK: Videotechnologie 1 / 2021_2022 / Laatste aanpassing op 2022-06-17.

Wat is het verschil tussen SD en SDI?

SD is standaard definitie. Het spreekt dus over de resolutie en de framerate van videobeelden.

SDI is Serial Digital Interface, de manier om digitale videobeeldten te versturen over een coaxkabel.

Zo bestaat er dus ook het verschil tussen SD-SDI en HD-SDI; standaard definitie digitale video over een coaxkabel en HD digitale video over een coaxkabel.

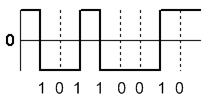

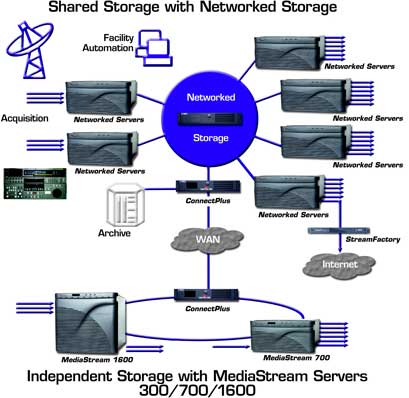

Servers (Digitale video)

2BGM: TVstudiotechnieken / 2005_2006 / Laatste aanpassing op 2006-06-25.

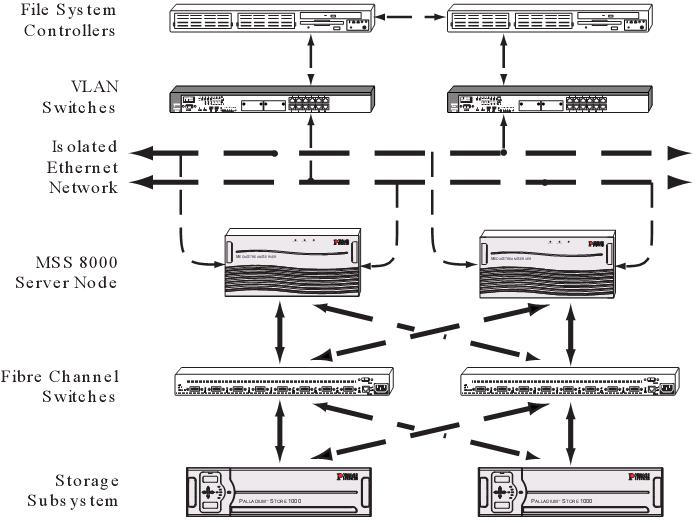

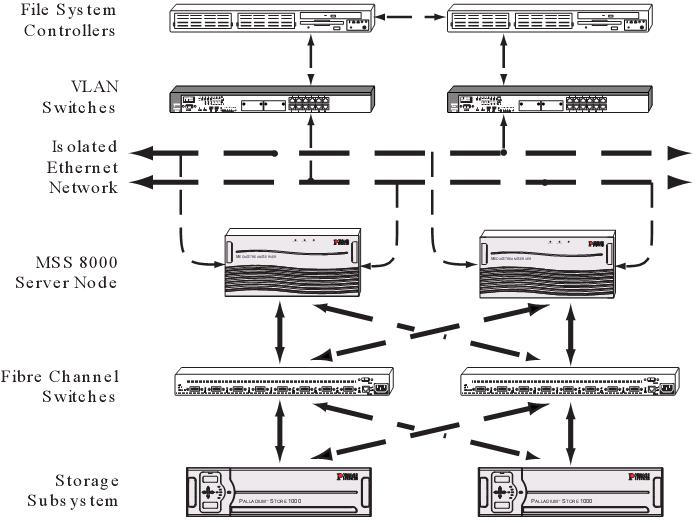

p 130, configuratie van een play-out)

U spreekt, onder de tekening, van 'servers', 'storage', 'file system

controller', 'gateway', 'ui' & het netwerk. Maar op de tekening staan de

file system controllers volledg vanboven. Dit zijn dus geen file system

controllers als in 'disk-controllers', als in 'scsi/ide controllers'? Moet ik

dit dan zien als een soort 'Media Management' systemen zoals beschreven op

p213?en het 'storage subsystem' als 'video servers' (zoals die mediastream 1600

in de tekening op p212)?

|

|

De videoserver in dit voorbeeld is een configuratie van

meerdere elementen.

Video I/O: dit is de box waar de video aansluitingen op

gebeuren. Deze heeft de video encoder (compressie) en decoder

(decompressie) borden.

Storage: de units die de harde schijven hebben.

Deze zijn via een fiber channel netwerk met de Video I/O verbonden.

Gateway: Computer die het netwerk toegang geeft tot de

storage van de server zodat ook andere zaken toegang hebben tot de storage van

het server systeem. De gateway kan bv montagesystemen, VOD (video on

demand) encoders verbinden met de storage.

UI: user interface

File System Controller: omdat de data op units staat die

ergens op het netwerk hangen, moet er ook minstens 1 systeem zijn dat weet

waar welke gegevens staan. Dat is de FSC.

Al deze zaken zaten vroeger samen in 1 systeem: de

videoserver. Omdat de Video I/O het meest typische is aan een

serversyteem, wordt dit ook wel eens de video server, of beter server node

genoemd.

Media management is een systeem dat van alle media

(videoclips, audiofragmenten, foto's, ...) binnen in een configuratie

(dus niet enkel op de videoservers) weet waar deze te vinden zijn, wanneer ze

zijn opgenomen, waar ze voor bedoeld zijn, ...

De Mediastream 1600 is een volledige videoserver.

Deze heeft ook de nodige storage aan boord. Via de 'connect plus' (de

gateway) staat dze in verbinding met een groter netwerk (WAN) met een andere

gateway die verbinding geeft met de networked storage. Op deze laatste

storage hanen dan weer server nodes.

Voordelen (Digitale video)

1BGM: Videotechnieken / 2005_2006 / Laatste aanpassing op 2006-09-23.

2. Wat is het nut van een tv-toestel met interne digitale verwerking in een

analoge omgeving?

Digitale toestellen zijn eenvoudiger te onderhouden.

Gemaakte instellingen verlopen niet met de temperatuur van de onderdelen of

met de tijd.

Deze stabiliteit vermindert de kostprijs van de

toestellen, en er moeten minder mensen worden ingezet hierdoor voor de

aanmaak/afregeling van een TVtoestel.

Voor analoge toestelen heeft men ook nauwkeurigere

voedingen nodig die de verschillende voltages in de TV aanmaken.

Bij digitale TV's zijn er ook extra mogelijkheden: PIP /

Freeze / ...